Auf meinen Blogpost Defender Aigis: Die Cyber-Wächter der KI-Sphären – oder: wie kann ich BYOAI eindämmen!? habe ich viel Feedback erhalten.

Neben dem Dank für den Post ist mir aufgefallen, dass viele meinten:

„Ich verstehe, warum bestimmte Dienste komplett gesperrt werden sollten, jedoch möchte ich meinen Usern mehr Flexibilität bieten und z.B. ChatGPT freigeben, ich möchte aber gleichzeitig verhindern, dass meine Unternehmensdaten dort Verwendung finden!

Hilf mir, da gibt’s doch bestimmt auch etwas von Microsoft!“

Da will ich mich natürlich nicht lumpen lassen, denn ganz klar, da gibt es etwas von Microsoft!

Das Vorgehen sieht für mich einen „Drei-Sprung“ vor:

Agenda

- Die Usersicht

- Blocken von absolut unerwünschten Diensten

- Erlauben von Ausnahmen

- Aber Unterbinden der Nutzung von Unternehmensdaten, sowohl Upload von Dateien als auch die Nutzung von Copy&Paste

- Daten in Copilot – geht gar nicht! 😉

- Fazit

0. Wie sieht es für die User aus?

Update: danke für euer Feedback! Ich habe die Reihenfolge geändert und das „wie vehält sich das System“ vor das „wie konfiguriere ich“ gezogen, damit sofort klar wird, was meine Absicht ist und dann die Step by Step Anleitung für die Konfiguration.

Hier die PowerPoint mit den 6 Schritten im Video und mit Speakernotes:

Deutsch: byoai-one-size-does-not-fit-all-DE.pptx

English: byoai-one-size-does-not-fit-all.pptx

Mein Dreisprung sieht also jetzt so aus:

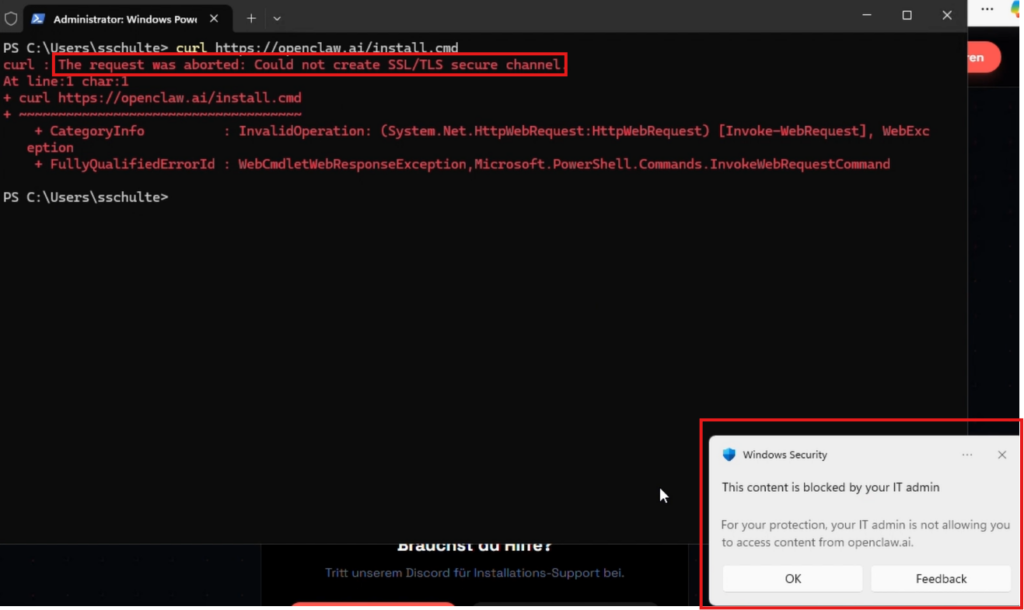

- curl https://openclan.ai/install.cmd

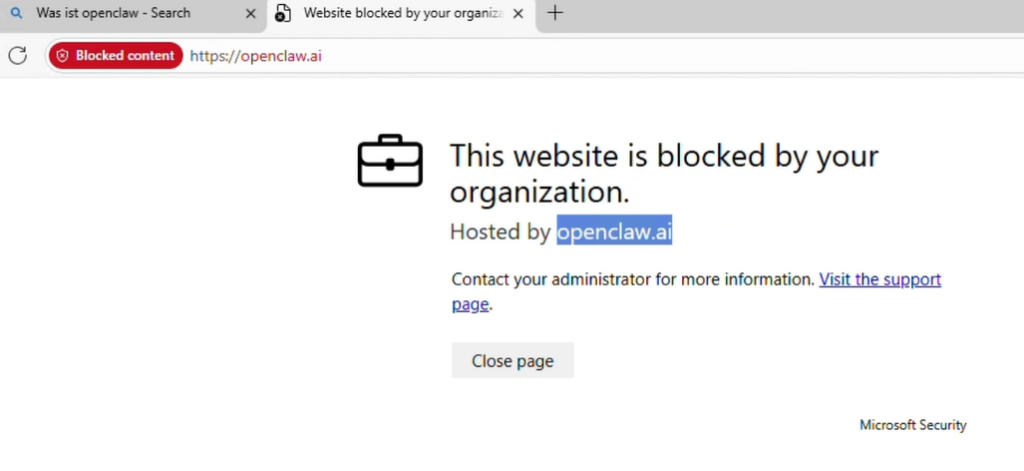

- Der direkte Aufruf von https://openclan.ai/

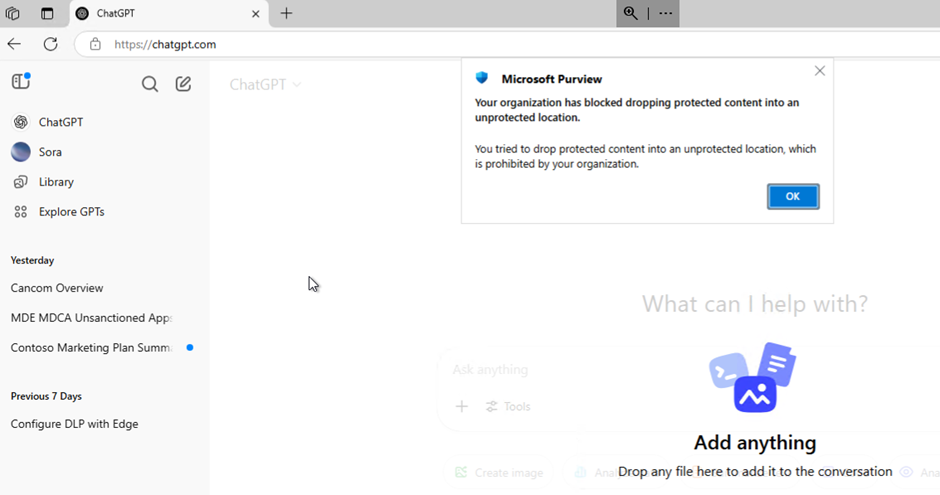

- ChatGPT funktioniert, https://chatgpt.com, jedoch, wenn eine gelabelte Datei hochgeladen werden soll:

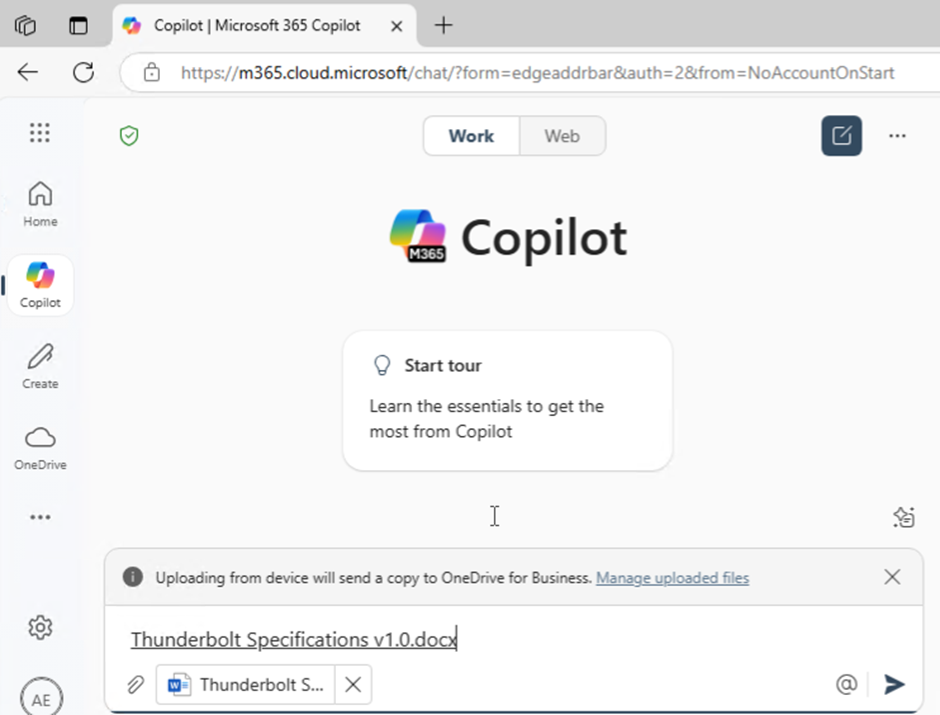

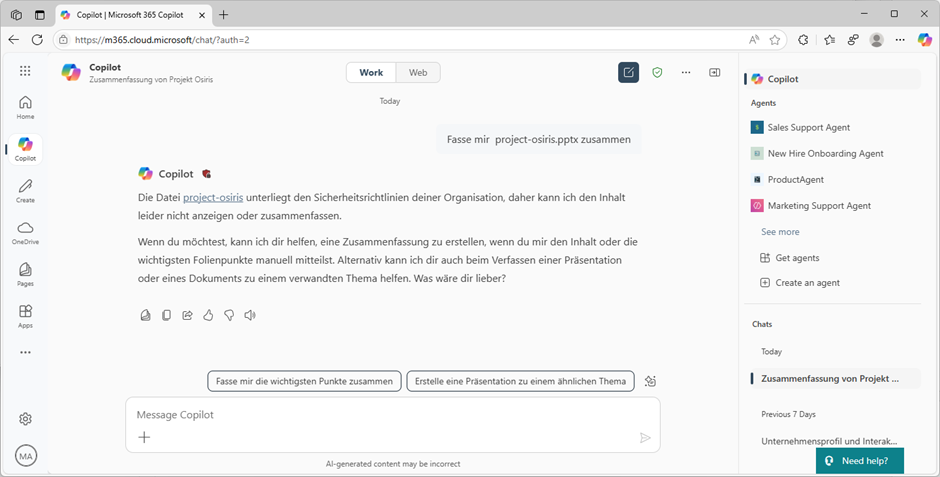

- https://m365.cloud.microsoft.com/chat mit der identischen Datei – geht natürlich 🥳:

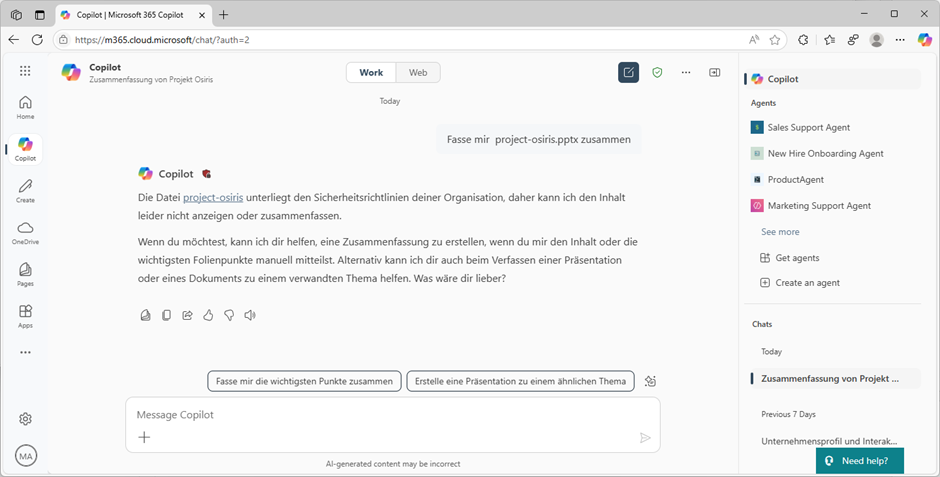

- Und zu guter Letzt, natürlich kann ich auch Daten vor Copilot schützen, doch mal ehrlich: warum sollte man das tun, wenn die Daten „eh in der Cloud“ liegen? 😉

aber wer will das schon?

1. Blocken von absolut unerwünschten Diensten

Da hat sich seit „Defender Aigis“ nichts dran geändert. Einen Stolperstein möchte ich kurz erwähnen, über den ich selber gestolpert bin:

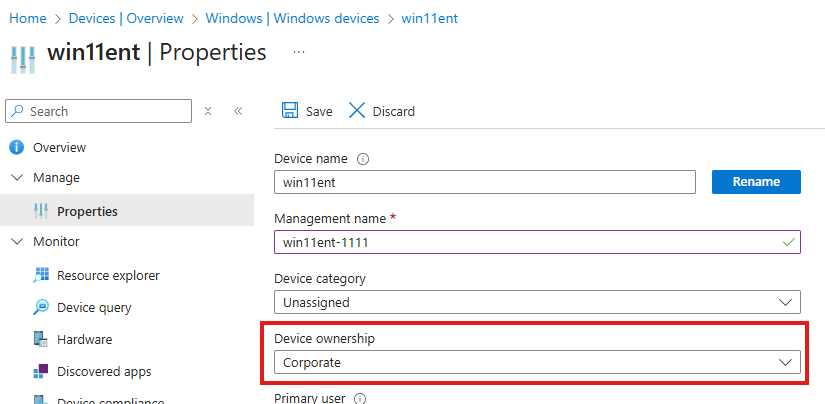

Vorbedingung: Das ist nur möglich, wenn ich einen in Defender for Endpoint ongebordeten (und damit gemanagten) Client habe, welcher als Corporate Device geflagged ist!

Und dann muss ich sicherstellen, dass die Policy „Enable Network Protection“ in Intune, bzw. die Group Policy: „GPS: Prevent users and apps from accessing dangerous websites“ auf „Enabled (Block)” gesetzt ist.

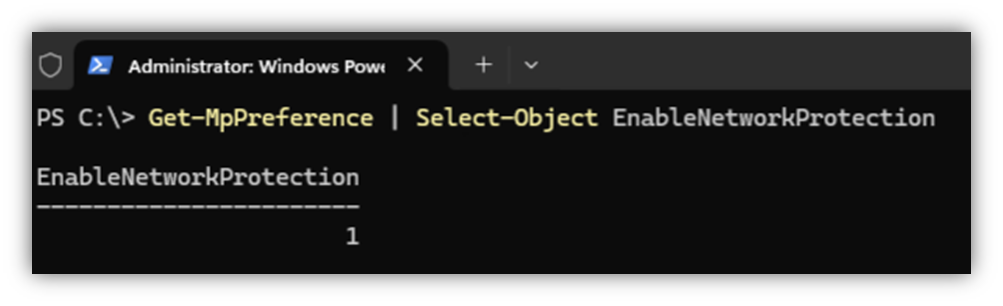

Überprüfen kann man dies über den (Admin) Powershell Befehl:

Get-MpPreference | Select-Object EnableNetworkProtection

Und zweiter Hinweis: es kann auch helfen, wenn man die Browserinstanz neustartet! *hust* 😉

2. Erlauben von Ausnahmen

Die Überschrift trügt ein wenig, denn eigentlich ist es genau andersherum: Es werden unter 1. Explizit Dienste gesperrt und für alle anderen Dienste werden dann weitere Policies in Microsoft Purview definiert.

Hier gibt es zwei Möglichkeiten:

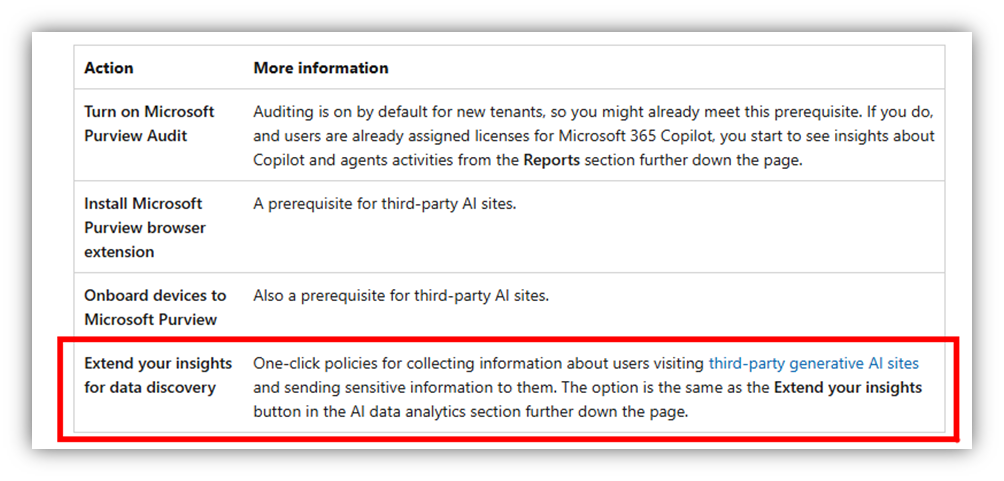

- One-Click Policies in Data Security Posture Management (DSPM) for AI => Microsoft Purview data security and compliance protections for Microsoft Copilot and other generative AI apps | Microsoft Learn

- Über den “richtigen” Weg von einer definierten DLP (Data Loss Prevention) Policy – und genau den werde ich beschreiben! (POV: die Policies werden eh an derselben Stelle in Purview DLP angelegt! 😱Von daher ist natürlich beides „richtig“! 😉 )

Damit wir den Weg über eine DLP Policy gehen können, müssen bestimmte Vorarbeiten erledigt werden:

- Datenklassifizierung 😱😱😱 JA, da führt spätestens jetzt kein Weg mehr dran vorbei! [Eigentlich etwas, dass vor 20 Jahren, oder zumindest zur DSGVO hätte passieren sollen! Prokrastination at it’s best! 😁Siehe: Best Practice Datenklassifizierung ]

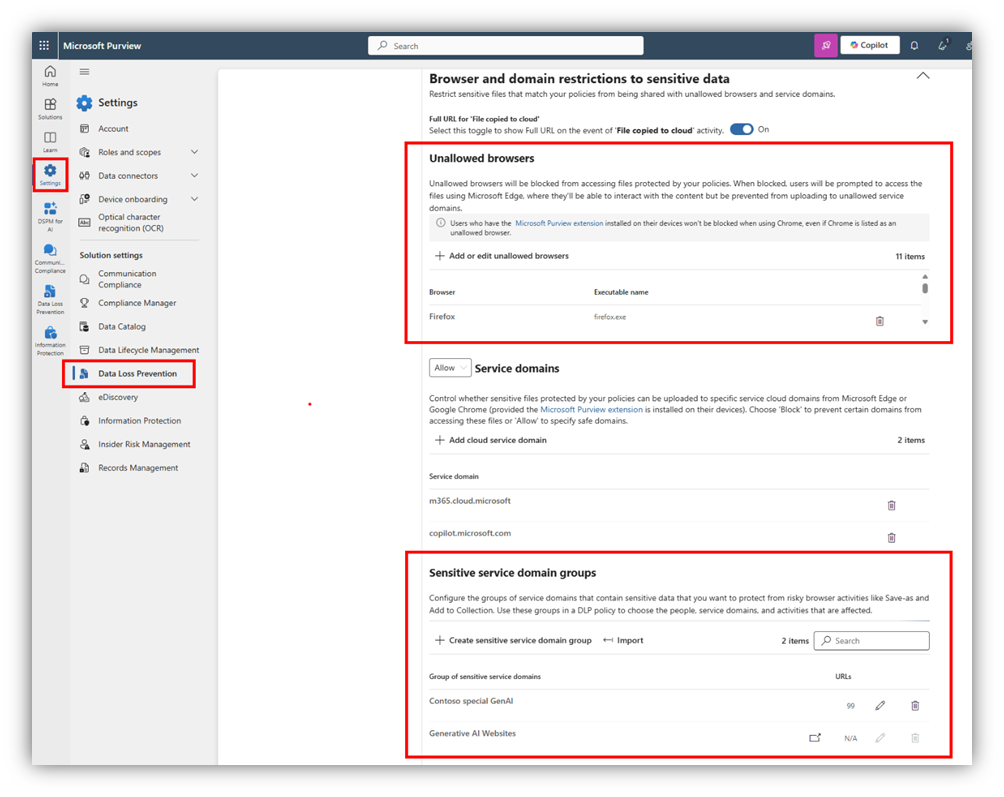

- Für den ersten Gebrauch zwar nicht notwendig, wenn es aber „granularer“ werden soll, dann: Wenn bestimmte Dienste unterschiedlich behandelt werden sollen, so muss in den Purview DLP Settings -> Endpoint DLP Settings sog. „Browser and domain restrictions to sensitive data“ konfiguriert werden. Insbesondere müssen die unerlaubten Browser ausgewählt werden und die “Sensitive service domain groups” konfiguriert werden:

3. Mastering DLP

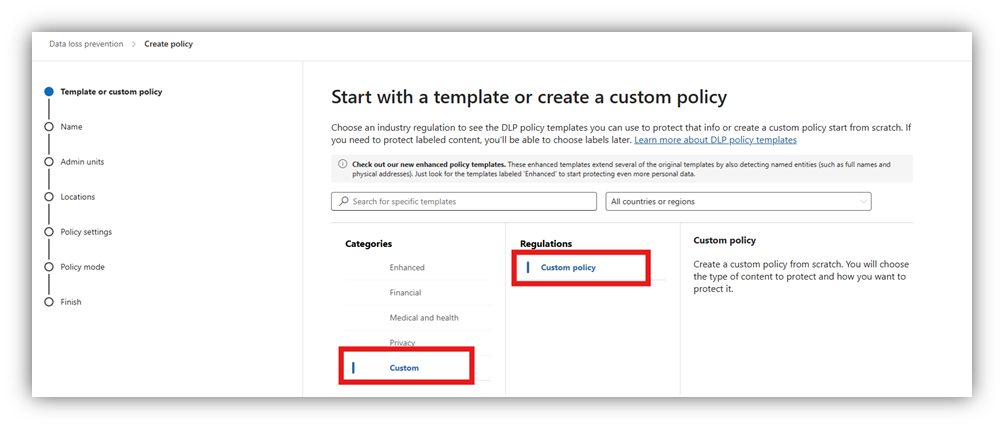

Wenn diese Voraussetzungen geschaffen wurden, dann kann jetzt die eigentliche DLP Policy erstellt werden (Die „obvious Steps“ wie „gib der Policy einen Namen“ überspringe ich in der positiven Annahme, dass ihr das selbst hinkriegt! 😝) :

- Bei der Template Auswahl am Anfang muss (!) Custom->Custom policy ausgewählt werden:

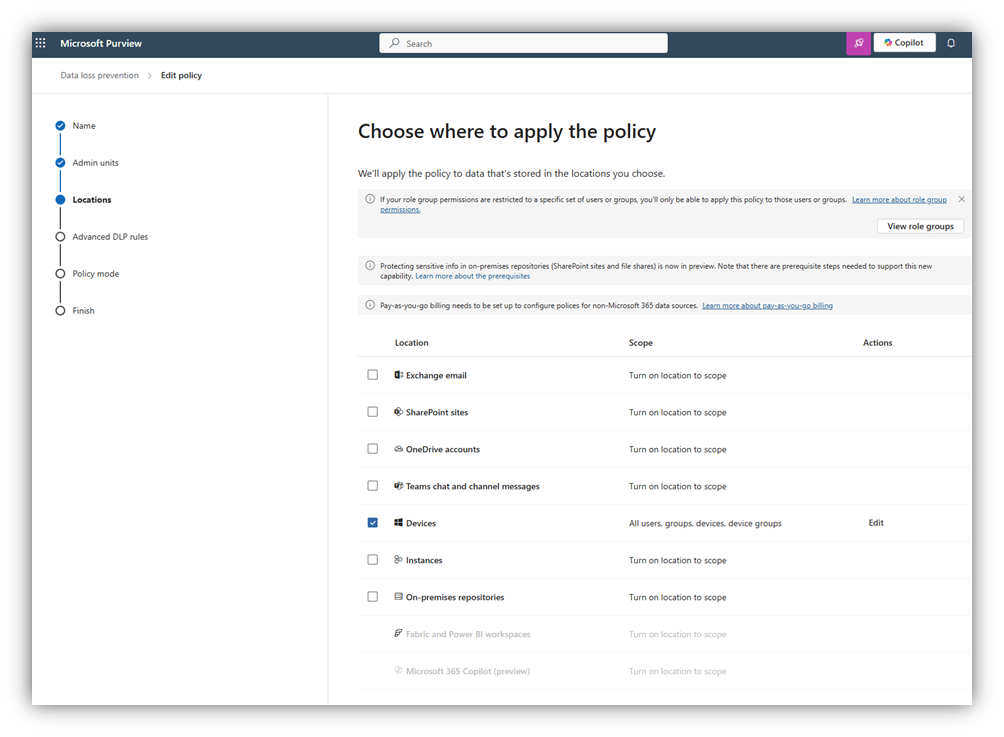

- Der erste Knackpunkt ist bei „Location“ / „Choose where to apply the policy”, denn diese Policy erfordert Endpoint DLP, ergo “Device“ als Selection only!

- Nun kommt die eigentliche “Arbeit”: Customize advanced DLP rules

Also flink auf „Create rule“ geklickt und dann legen wir so richtig los - Zuallererst geben wir der Rule einen vernünftigen Namen ich habe folgenden gewählt: „All labeled content except public and personal“

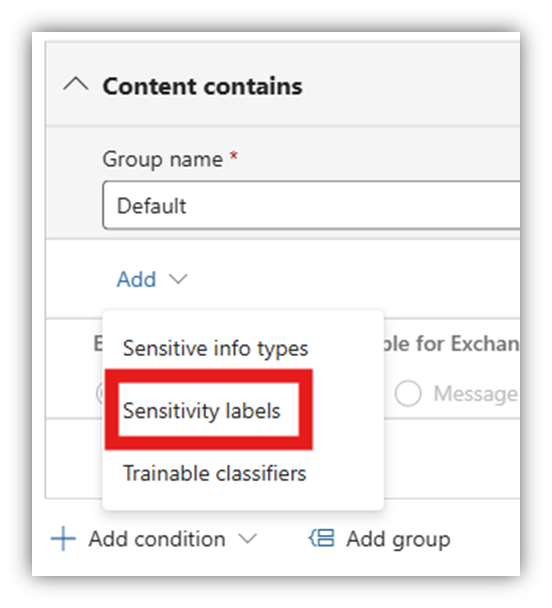

- Jetzt brauchen wir eine „Condition“ und hier kommt vor allem die Pre-Work des Labelings ins Spiel, denn unsere erste Condition lautet

„Content Contains“->“Sensitivity Labels“

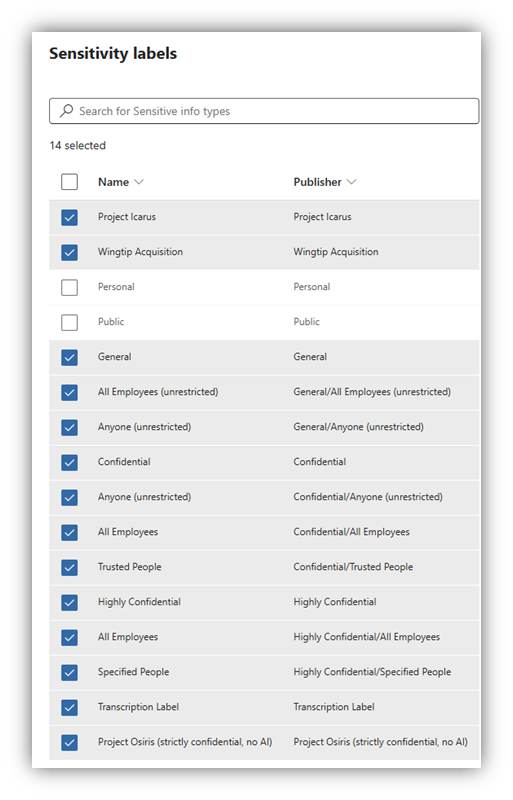

Und hier sind wir natürlich nicht knausrig und wählen alle Label außer die, die wir explizit ausnehmen wollen, also in meinem Fall „Public“ und „Personal“.

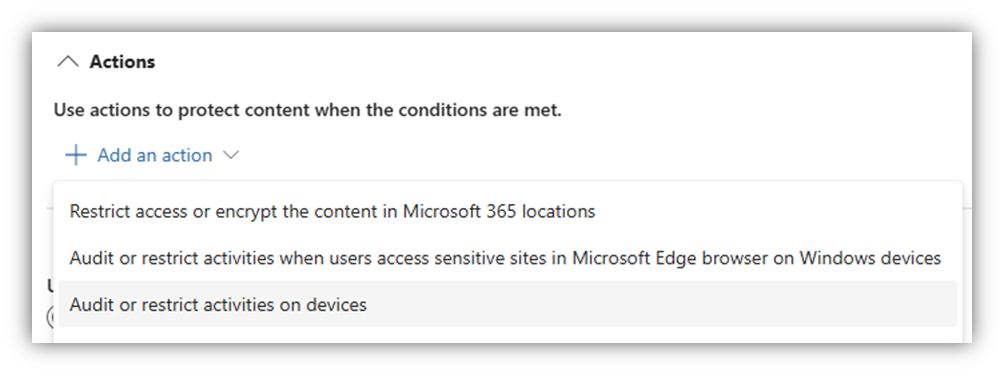

- Jetzt fängt der Spaß an und wir definieren die Action, die ausgeführt werden soll:

Wir wählen als mögliche Action folgendes aus: „Audit or restrict activities on devices“

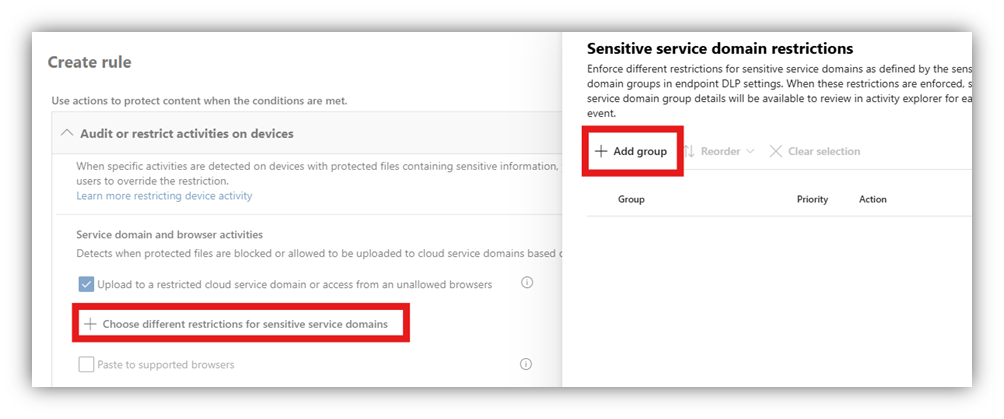

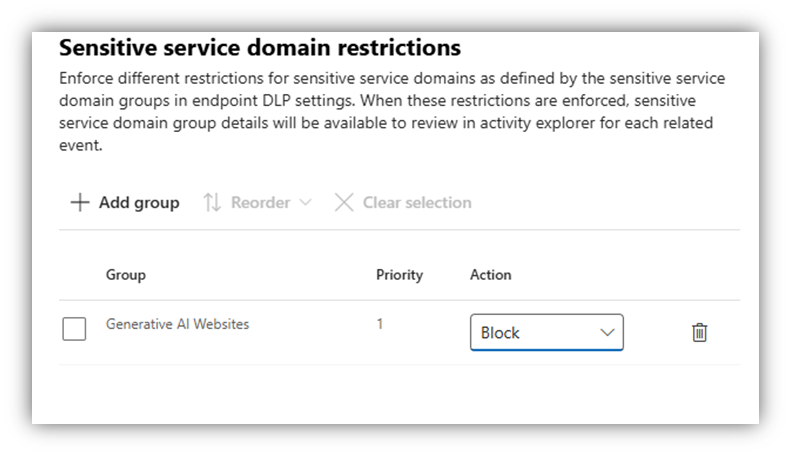

- Erste Aktion hier ist dann „Choose different restrictions for sensitive service domains“ und dort „Add group“ ->

Und im „einfachen“ Fall wählen wir die pre-defined Gruppe „Generative AI Websites“

Dort sind ähnlich wie bei der MDCA Generative AI Category vordefinierte AI Services definiert. Diese Liste ist allerdings kürzer! Also ggf. muss hier ein Abgleich eigenständig vorgenommen werden! => Supported AI sites by Microsoft Purview for data security and compliance protections | Microsoft Learn

Vergesst nach dem Click auf „Add“ nicht, noch die Action auf „Block“ umzustellen! Ja, wir sind die fiesen Admins, die hier restriktiv agieren! 😈

- Selbiges führen wir noch bei „Paste to supported Browsers“ aus (Die Screenshots erspare ich euch, die sehen identisch wie oben aus! 😉)

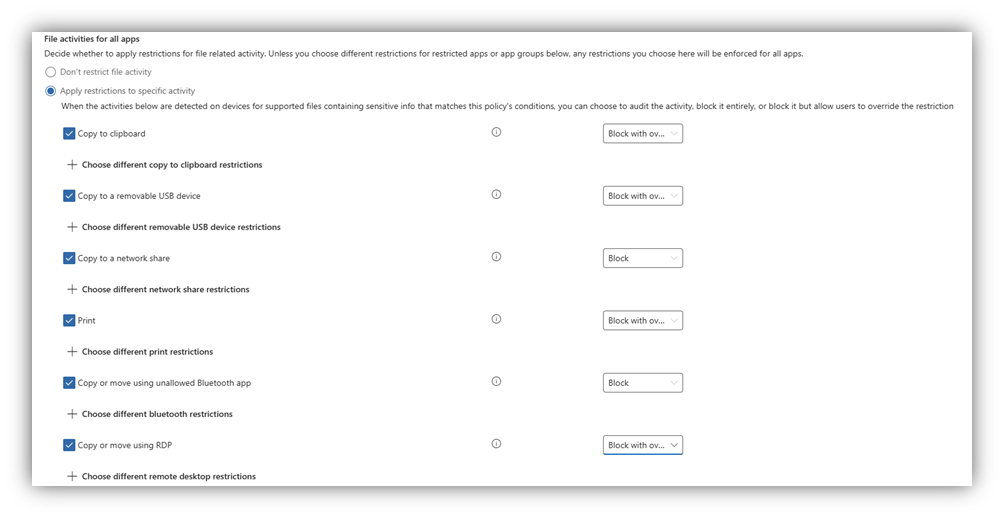

- Für den nächsten Abschnitt müsst ihr noch die Entscheidungen treffen, wie grundsätzlich mit geschütztem Content umgegangen werden soll, hier mal mein Vorschlag:

- Den Rest lassen wir (für heute) so, wie er ist und drücken auf „Save“->“Next“.

- Der nächste Screen bringt uns zu „sofort scharfschalten“ oder „erst Testen“ – da ich in meinem Testtenant unterwegs bin: „sofort scharfschalten“, was ihr macht, müsst ihr entscheiden! 😉

- Dann noch „Next“-„Finish“ und wir sind fertig! 🥳🎉

4. Daten in Copilot? Geht gar nicht! 😉

In seltensten Fällen, habe ich mir sagen lassen, soll es vorkommen, dass es Vorschriften – oder zumindest den Wunsch – gibt, dass Copilot bestimmte, super brisante Dokumente und Daten gar nicht verarbeiten können soll.

Hinweis: Sofern die Daten „eh in der Cloud“ sind – macht es technologisch und aus einer Risikoperspektive keinen Unterschied, ob die Daten durch Copilot verarbeitet werden – aber, Kundenwunsch ist Kundenwunsch und dem kommen wir natürlich nach:

aber wer will das schon?

Die technische Umsetzung erfolgt ebenfalls über spezielle DLP Policies. Da diese zum Zeitpunkt der Erstellung dieses Post noch in Preview sind, spare ich mir die Konfiguration und reiche diese nach, sobald die Funktionalität GA Status erreicht hat. Hier ist die zugehörige Dokumentation: Learn about the Microsoft 365 Copilot location (preview) | Microsoft Learn

5. Fazit

Durch den Einsatz von gemanagten Devices in Tateinheit mit Microsoft Defender for Endpoint, Microsoft Defender for Cloud Apps und ausgeklügelten Microsoft Purview Data Loss Prevention Policies kann ich die Generative AI Welt im Zaum halten, die Daten schützen und den Usern die Flexibilität geben, die sie fordern und als Erwachsene auch haben sollten!

Hier erwächst eine zunehmende Verantwortung für die IT und Compliance Verantwortlichen, dass die überaus mächtige und sich schnell verändernden KI Tools für und mit den Usern gemanagt werden müssen.